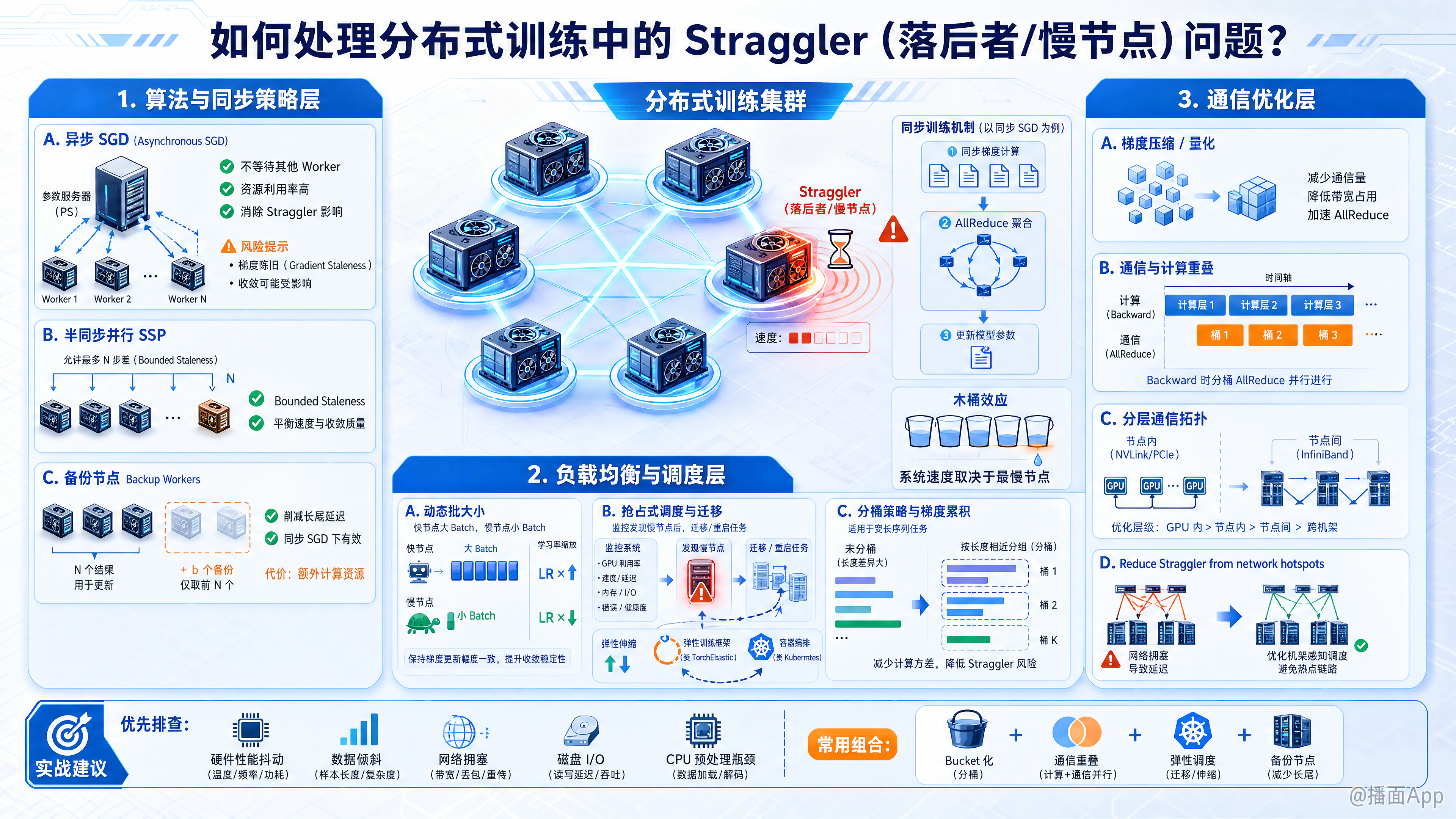

如何处理分布式训练中的 Straggler(落后者/慢节点)问题?

在分布式训练(Distributed Training)中,Straggler(落后者/慢节点) 是指在并行计算集群中,处理速度显著慢于其他节点的机器或进程。

由于目前主流的训练模式是 同步 SGD(Synchronous SGD),即所有节点必须在每一步(Step)结束时进行梯度同步(AllReduce),整个系统的速度取决于最慢的那个节点(木桶效应)。因此,处理 Straggler 是提升集群效率的关键。

以下是处理 Straggler 问题的几种主要策略,按从算法层到系统层的顺序分类:

1. 算法与同步策略层 (Synchronization Strategies)

这是最直接的应对方式,通过改变参数更新的机制来容忍慢节点。

异步 SGD (Asynchronous SGD):

- 原理: 各个 Worker 独立计算梯度并推送到参数服务器(Parameter Server),不需要等待其他 Worker。

- 优点: 完全消除了 Straggler 的影响,计算资源利用率极高。

- 缺点: 会引入梯度陈旧(Gradient Staleness) 问题,导致模型收敛困难或精度下降。目前在追求高精度的训练中已较少作为首选,但在联邦学习等场景仍有应用。

半同步并行 (Stale Synchronous Parallel, SSP):

- 原理: 介于同步和异步之间。允许最快的节点比最慢的节点多跑 步(Bounded Staleness)。如果差距超过 ,快节点强制等待。

- 优点: 平衡了速度和收敛质量。

备份节点 (Backup Workers / Straggler Mitigation):

- 原理: 这是 Google 在 TensorFlow 中常用的策略。假设你需要 个梯度来更新参数,你启动 个 Worker。在每一步中,只要收到前 个 Worker 的结果,就立即进行更新,并丢弃剩下 个慢节点的结果。

- 优点: 在同步 SGD 架构下非常有效,能显著削减长尾延迟(Tail Latency)。

- 代价: 需要额外的计算资源( 个节点的算力是被“浪费”的)。

2. 负载均衡与调度层 (Load Balancing & Scheduling)

如果不想改变同步算法,可以通过动态调整负载来适应不同节点的处理能力。

动态批大小 (Dynamic Batch Sizing):

- 原理: 根据 Worker 的实时处理速度分配数据。快节点分配大的 Batch Size,慢节点分配小的 Batch Size。

- 注意: 需要对学习率(Learning Rate)进行相应的缩放(Linear Scaling Rule),以保证数学上的等价性或近似性。

抢占式调度与迁移 (Preemption & Migration):

- 原理: 监控系统实时检测慢节点。一旦发现某个节点持续成为 Straggler,调度器将其标记为不健康,将其任务迁移到新的节点上,或者直接重启该 Pod/进程。

- 工具: PyTorch 的 TorchElastic (c10d) 支持弹性训练,允许节点动态加入或退出,配合 Kubernetes 可以实现故障节点的自动替换。

分桶策略 (Bucketization) 与 梯度累积:

- 在处理变长序列(如 NLP 中的 BERT/GPT)时,Straggler 往往是因为某个节点分到了特别长的数据。

- 对策: 将长度相近的数据分在同一个 Batch 或同一个节点处理,减少计算量的方差。

3. 通信优化层 (Communication Optimization)

很多时候,Straggler 并不是计算慢,而是网络慢(带宽受限或丢包重传)。

梯度压缩 (Gradient Compression):

- 原理: 减少节点间传输的数据量。

- 技术: FP16/BF16 混合精度训练(减少一半带宽)、梯度量化(如 1-bit SGD, INT8)、梯度稀疏化(只传输 Top-K 大梯度的值)。

- 效果: 降低了对网络带宽的依赖,减轻了网络慢节点的阻塞影响。

重叠计算与通信 (Overlapping Compute and Communication):

- 原理: 在计算后几层梯度的同时,开始传输前几层的梯度。

- 效果: 虽然不能消除 Straggler,但能掩盖部分通信延迟,提升整体吞吐量。现代框架(PyTorch DDP, Horovod)默认都开启此功能。

4. 基础设施与硬件层 (Infrastructure & Hardware)

从根源上解决导致慢节点的环境问题。

硬件同构化 (Homogeneity):

- 尽量确保集群内的 GPU 型号、网络带宽、CPU 核数一致。避免将 V100 和 A100 混用进行同步训练。

资源隔离 (Resource Isolation):

- Straggler 常因“邻居干扰”(Noisy Neighbor)产生。例如,同一台物理机上的其他容器占用了大量 PCIe 带宽或 CPU 缓存。

- 对策: 使用 Docker/K8s 进行严格的 CPU 绑核(CPU Pinning),独占网卡队列,确保 I/O 隔离。

热节流检测 (Thermal Throttling Detection):

- GPU 温度过高会自动降频。运维层面需要监控 GPU 时钟频率,及时下线散热故障的机器。

总结建议

在实际生产环境中,处理顺序通常是:

- 基础排查: 确保硬件同构,没有明显的硬件故障(如降频、网络丢包)。

- 框架优化: 开启混合精度训练(AMP)和计算通信重叠(DDP 默认开启)。

- 弹性容错: 使用 TorchElastic 等弹性框架,直接踢掉由于故障导致的极端慢节点。

- 算法兜底: 如果集群规模极大(如上千卡),硬件异构不可避免,考虑使用 Backup Workers 策略(牺牲少量算力换取整体速度)。

播面

播面