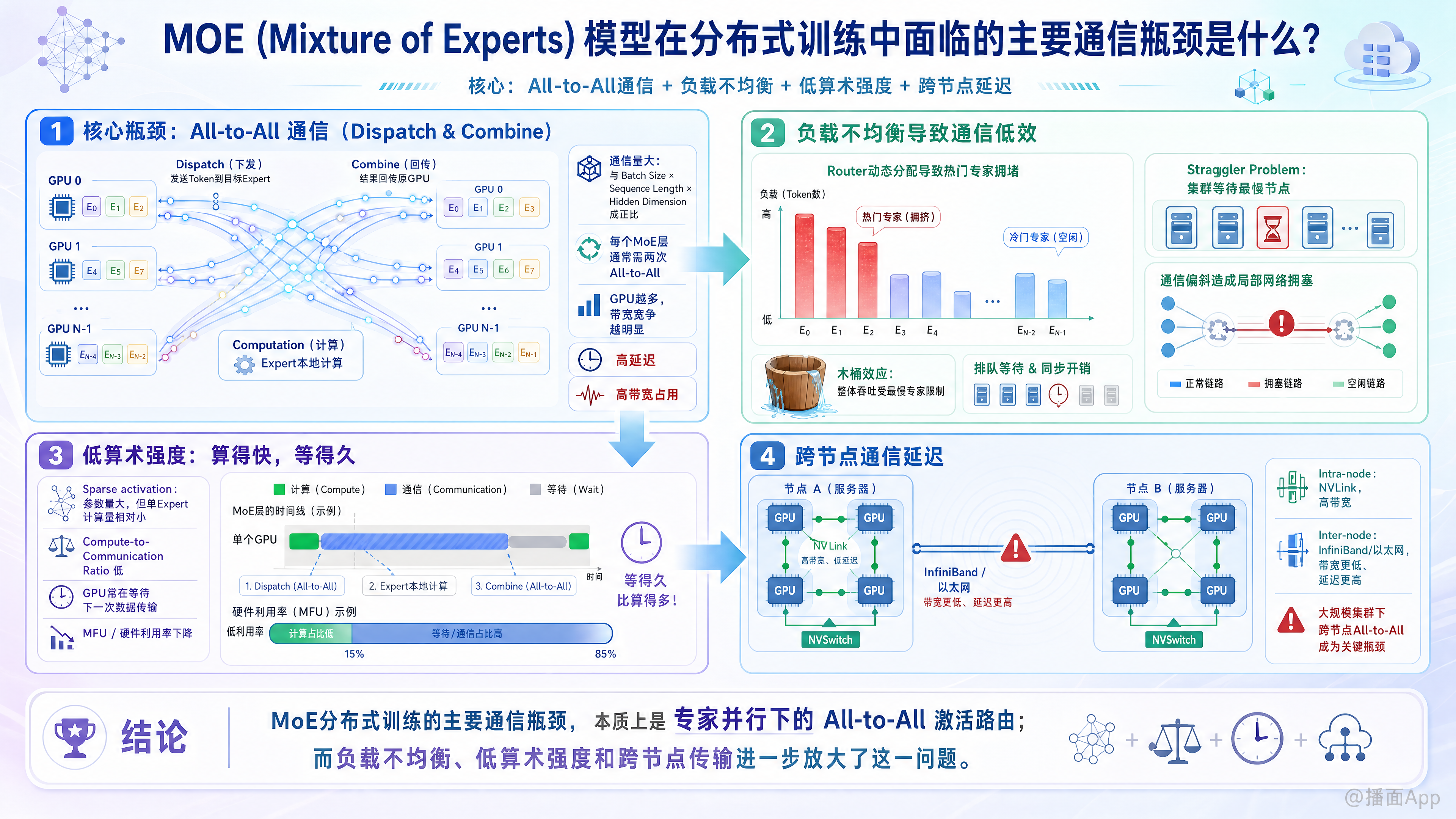

MOE (Mixture of Experts) 模型在分布式训练中面临的主要通信瓶颈是什么?

在分布式训练 Mixture of Experts (MoE) 模型时,最核心的通信瓶颈主要源于 专家并行(Expert Parallelism) 策略下的数据路由过程。

简单来说,MoE 的通信瓶颈可以归纳为:All-to-All 通信原语的高延迟与带宽占用,以及由负载不均衡导致的通信与计算等待。

以下是详细的深度解析:

1. 核心瓶颈:All-to-All 通信 (Dispatch & Combine)

在标准的 Transformer 中,数据通常只需在层与层之间流动(模型并行)或仅在反向传播时同步梯度(数据并行)。但在 MoE 中,引入了动态路由机制:

- 机制: 输入的 Token 被 Router(门控网络)分配给不同的 Expert。在专家并行模式下,不同的 Expert 驻留在不同的 GPU/TPU 上。

- 过程:

- Dispatch(分发): GPU A 上的 Token 可能被分配给 GPU B 上的 Expert。这意味着 GPU A 必须将该 Token 的激活值(Activations)发送给 GPU B。当所有 GPU 都要互相发送数据时,这就是一个 All-to-All 操作。

- Computation: Expert 进行计算。

- Combine(聚合): 计算完成后,GPU B 必须将结果传回 Token 原本所在的 GPU A,以便进行下一层的计算。这又是一次 All-to-All 操作。

- 瓶颈点:

- 通信量大: 传输的是激活值(Activations),其数据量与

Batch Size * Sequence Length * Hidden Dimension成正比。 - 频次高: 每个 MoE 层(通常每隔一层就是一个 MoE 层)都需要进行两次 All-to-All 通信。

- 带宽竞争: 随着 GPU 数量增加,All-to-All 的连接复杂度急剧上升,容易占满节点间(Inter-node)的网络带宽。

- 通信量大: 传输的是激活值(Activations),其数据量与

2. 负载不均衡 (Load Imbalance) 导致的通信低效

MoE 的路由是动态的,Router 可能会将大部分 Token 分配给少数几个“热门”专家,而其他专家则很空闲。

- 木桶效应(Straggler Problem): All-to-All 通信是同步操作。如果 GPU A 需要接收的数据量远大于 GPU B(因为 GPU A 上的专家被分配了更多 Token),那么所有其他 GPU 在发送完数据给 GPU A 之前都不能结束通信阶段。整个集群必须等待最慢的那个节点完成接收/发送。

- 通信偏斜: 这种不均匀的数据分布导致网络流量分布不均,容易造成局部网络拥塞。

3. 低算术强度 (Low Arithmetic Intensity)

与稠密模型(Dense Models)相比,MoE 模型的特点是“参数量巨大,但计算量相对较小”(Sparse activation)。

- 计算通信比(Compute-to-Communication Ratio): MoE 的每个 Expert 处理的 Token 数量较少,计算时间短。这意味着 GPU 很快就完成了计算,然后立即需要进行下一次 All-to-All 通信。

- 结果: 通信占比显著提升。如果网络带宽不够高,GPU 大部分时间都在等待数据传输,而不是在计算,导致硬件利用率(MFU)低下。

4. 跨节点通信延迟 (Inter-node Latency)

在超大规模集群中,GPU 分布在不同的物理机节点上。

- 节点内 vs 节点间: 节点内(Intra-node)通常使用 NVLink 等高速互连,带宽极高。但 MoE 的 All-to-All 通信往往需要跨越节点(Inter-node),依赖 InfiniBand 或以太网。

- 瓶颈: 节点间的带宽通常远低于节点内带宽。如果 Router 将大量 Token 路由到其他节点的 Expert 上,网络延迟将成为主要性能杀手。

总结与业界解决方案

为了缓解这些瓶颈,业界通常采用以下优化手段:

- 限制容量与丢弃 Token (Capacity Factor & Token Dropping): 强制限制每个 Expert 能处理的最大 Token 数,多余的 Token 被丢弃或通过残差连接跳过。这强制实现了负载均衡和通信量的确定性。

- 分层 All-to-All (Hierarchical All-to-All): 针对节点间带宽低的问题,先在节点内聚合数据,再进行节点间传输,减少跨节点的小包通信。

- 通信与计算重叠 (Overlapping): 在进行 All-to-All 通信的同时,利用空闲的算力进行非 MoE 层(如 Attention 层)的计算。

- 辅助负载均衡损失 (Auxiliary Load Balancing Loss): 在训练 Loss 中加入惩罚项,迫使 Router 尽可能均匀地将 Token 分配给各个 Expert。

- DeepSpeed-MoE / Tutel 等库的优化: 使用定制的 CUDA 核函数优化 All-to-All 的底层实现。

播面

播面