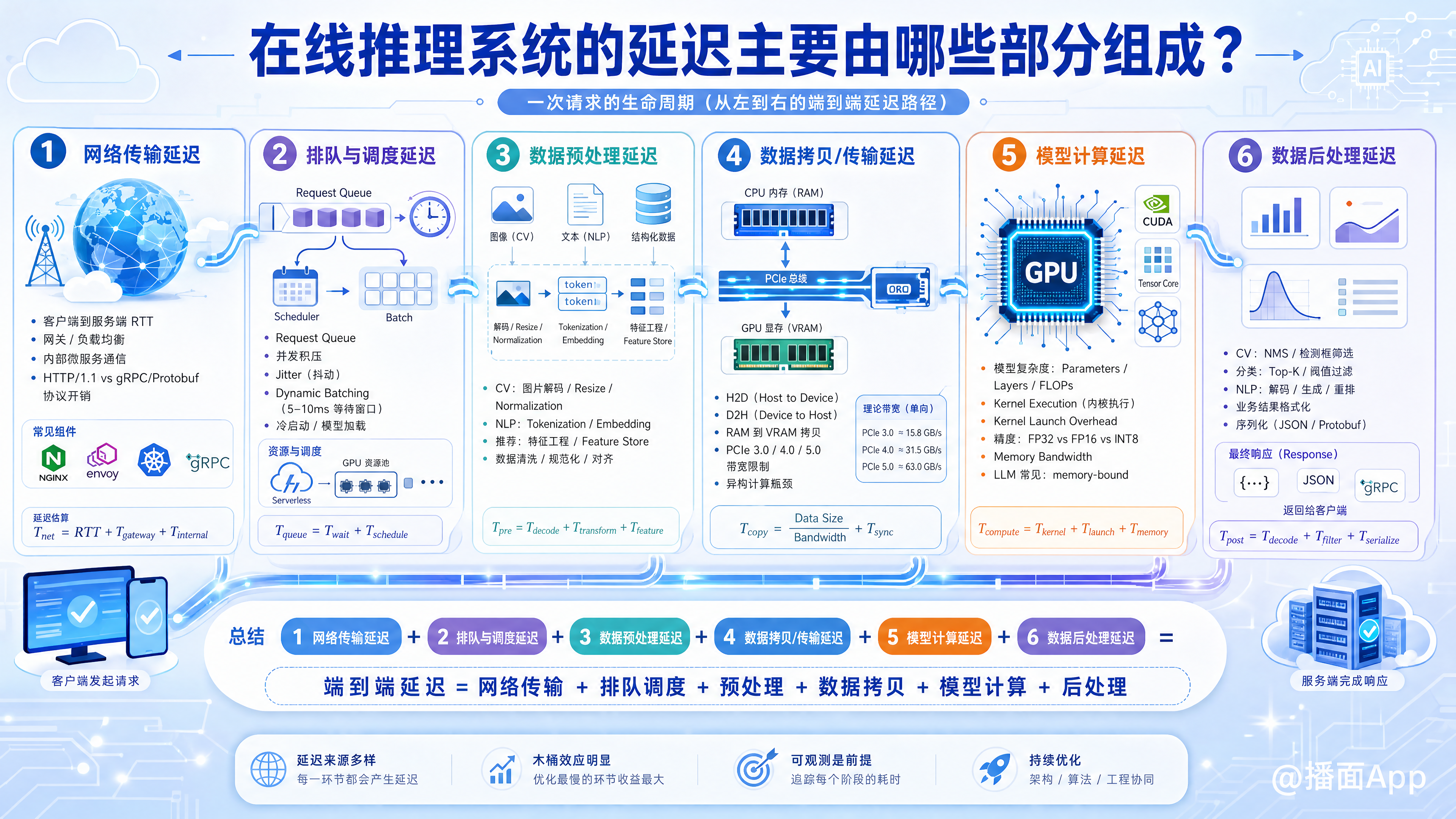

在线推理系统的延迟主要由哪些部分组成?

在线推理系统(Online Inference System)的端到端延迟(End-to-End Latency)是指从客户端发出请求到接收到响应的总时间。这个时间通常可以拆解为以下几个主要部分。

为了方便理解,我们可以按照请求的生命周期顺序来划分:

1. 网络传输延迟 (Network Latency)

这是请求在物理网络中传输的时间,通常是不可控因素最多的部分。

- 客户端到服务端 (RTT): 取决于用户的地理位置、网络带宽和网络质量。

- 网关与负载均衡: 请求经过 Nginx、Envoy 或 Kubernetes Ingress 等组件时的转发耗时。

- 内部微服务通信: 如果推理服务是微服务架构的一部分,服务间调用(如 gRPC/HTTP)也会产生网络开销。

- 协议开销: HTTP/1.1 的文本解析开销通常大于 gRPC (Protobuf) 的二进制解析开销。

2. 排队与调度延迟 (Queuing & Scheduling Latency)

当请求到达推理服务器,但计算资源(GPU/CPU)繁忙时,请求必须等待。

- 请求队列 (Request Queue): 如果并发请求量超过了系统的处理能力,请求会在队列中积压。这是高并发场景下延迟抖动(Jitter)的主要来源。

- 动态批处理 (Dynamic Batching): 为了提高吞吐量(Throughput),服务端通常会等待一小段时间(如 5ms-10ms)以凑齐一批请求(Batch)一起送入 GPU。这个等待窗口就是延迟的代价。

- 模型加载/冷启动: 在 Serverless 架构中,如果实例未启动或模型未加载进显存,会有巨大的冷启动延迟。

3. 数据预处理延迟 (Pre-processing Latency)

模型无法直接理解原始数据(如图片文件、文本字符串),需要转换为张量(Tensor)。这部分通常在 CPU 上进行。

- CV (计算机视觉): 图片解码(JPEG decode)、缩放(Resize)、归一化(Normalization)、通道转换。

- NLP (自然语言处理): 分词(Tokenization)、文本清洗、Embedding 查找。

- 特征工程: 对于推荐系统,需要从特征存储(Feature Store)拉取特征并进行拼接。

4. 数据拷贝/传输延迟 (Data Transfer / Memory Copy)

这是异构计算(CPU + GPU)特有的瓶颈。

- Host-to-Device (H2D): 将处理好的 Tensor 从 CPU 内存(RAM)拷贝到 GPU 显存(VRAM)。这受限于 PCIe 总线带宽(如 PCIe 3.0 vs 4.0 vs 5.0)。

- Device-to-Host (D2H): 推理完成后,将结果从 GPU 显存拷回 CPU 内存。

5. 模型计算延迟 (Model Compute / Inference Latency)

这是 GPU/加速器实际执行矩阵运算的时间,是核心部分。

- 模型复杂度: 参数量(Parameters)、层数(Layers)、计算量(FLOPs)。

- 算子执行 (Kernel Execution): 具体的矩阵乘法、卷积、激活函数执行时间。

- Kernel Launch Overhead: CPU 指挥 GPU 启动算子的指令开销(对于小模型,这个开销占比可能很高)。

- 精度: FP32 比 FP16 或 INT8 慢。

- 显存带宽 (Memory Bandwidth): 对于大语言模型(LLM),推理往往是受限于显存带宽(Memory-bound)而不是计算速度(Compute-bound)。

6. 数据后处理延迟 (Post-processing Latency)

模型输出的通常是概率分布或原始数值,需要转换为业务可用的格式。

- CV: 非极大值抑制(NMS,用于目标检测去重)、坐标还原、掩码生成。

- NLP: 反分词(Detokenization,将 ID 转回文本)。

- 逻辑处理: 过滤低置信度结果、格式化为 JSON 等。

7. 序列化与反序列化 (Serialization/Deserialization)

- 将最终的对象结果转换为网络传输格式(如 JSON 字符串或 Protobuf 二进制流)并发送回客户端。

特别说明:针对大语言模型 (LLM) 的延迟指标

对于像 ChatGPT 这样的生成式模型,延迟通常被细分为两个关键指标:

- 首字延迟 (TTFT - Time To First Token):

- 用户发出请求到看到第一个字出现的时间。

- 主要受 Prefill(预填充)阶段 影响,即处理输入 Prompt 的时间。

- 字间延迟 (TPOT - Time Per Output Token):

- 生成每一个后续字符的时间。

- 主要受 Decode(解码)阶段 影响,受限于 KV Cache 的读取速度和显存带宽。

总结与优化方向

| 延迟来源 | 常见优化手段 |

|---|---|

| 网络 | 边缘计算、HTTP/2、gRPC、压缩传输 |

| 排队 | 自动扩缩容、优化 Batching 策略、请求优先级 |

| 预/后处理 | C++ 重写 Python 代码、使用 NVIDIA DALI (GPU 处理图片) |

| 数据拷贝 | Pinned Memory (锁页内存)、流水线并行 |

| 模型计算 | 量化 (INT8/FP16)、算子融合 (Operator Fusion)、模型剪枝、使用 TensorRT/vLLM |

理解这些组成部分有助于在进行性能调优时,通过 Profiling 工具(如 Nsight Systems, PyTorch Profiler)精准定位瓶颈是卡在 CPU、GPU 计算、还是 PCIe 带宽上。

播面

播面