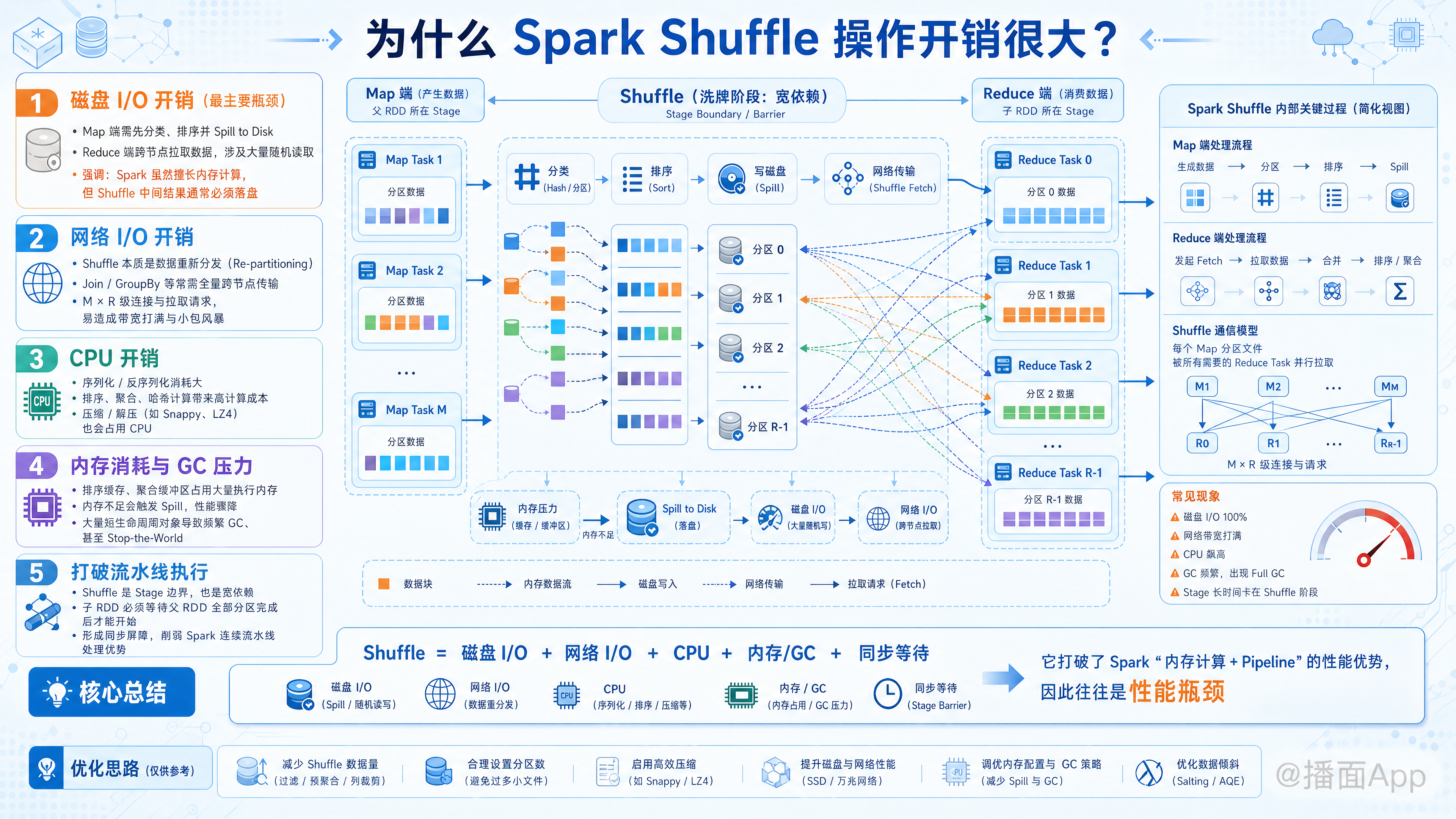

为什么 Spark Shuffle 操作开销很大?

Spark Shuffle(洗牌)操作之所以开销巨大,是因为它打破了 Spark “内存计算”和“流水线执行”的优势,强制触发了大量的磁盘 I/O、网络 I/O、CPU 序列化/反序列化以及内存消耗。

简单来说,Shuffle 是将数据从一个节点(Map 端)重新分发到其他节点(Reduce 端)的过程(例如 groupByKey, reduceByKey, join 等操作)。

以下是 Shuffle 开销大的具体原因分析:

1. 磁盘 I/O 开销 (Disk I/O) —— 最主要的瓶颈

虽然 Spark 是内存计算引擎,但 Shuffle 阶段为了保证容错(Fault Tolerance)和应对内存不足,必须将中间结果写入磁盘。

- Map 端写磁盘: 每个 Map 任务在计算结束后,不能直接把数据发给 Reduce 端(因为 Reduce 端可能还没启动,或者内存放不下),必须先将数据分类、排序并写入本地磁盘(Spill to Disk)。

- Reduce 端读磁盘: Reduce 任务启动后,需要跨节点去拉取(Fetch)属于自己的那部分数据。这涉及到大量的随机读取(Random Read),机械硬盘在随机读写时的性能非常差。

2. 网络 I/O 开销 (Network I/O)

Shuffle 的本质是数据的重新分发(Re-partitioning)。

- 全量数据传输: 在大多数 Shuffle 场景下(如 Join 或 GroupBy),几乎所有的数据都需要在集群的不同节点之间进行传输。如果数据量是 TB 级别,网络带宽很容易被打满,导致网络拥塞。

- 连接数爆炸: 假设有 个 Map 任务和 个 Reduce 任务,理论上会产生 次网络连接和数据拉取请求。如果 和 很大,会产生海量的小包传输,严重消耗网络资源。

3. CPU 开销 (CPU Overhead)

CPU 在 Shuffle 过程中非常忙碌,主要消耗在以下几个方面:

- 序列化与反序列化 (Serialization/Deserialization): 数据在网络传输和写磁盘前必须序列化成二进制流,读取后必须反序列化成对象。这是非常消耗 CPU 的操作(尤其是 Java 对象序列化)。

- 排序与聚合 (Sorting & Aggregation): Spark 默认的 SortShuffleManager 在 Map 端写出前和 Reduce 端读取后,通常会对数据进行排序(Sort)或哈希聚合(Hash),这需要大量的计算能力。

- 压缩与解压 (Compression): 为了减少磁盘和网络 IO,Shuffle 数据通常会被压缩(如 Snappy, LZ4),这也需要 CPU 参与。

4. 内存消耗与 GC 压力 (Memory & GC)

- 执行内存占用: Shuffle 过程中需要大量的内存缓冲区(Buffer)来存储中间数据(例如 Map 端的排序缓存,Reduce 端的聚合 Map)。如果内存不足,就会强制触发溢写磁盘(Spill),导致性能急剧下降。

- 垃圾回收 (GC): Shuffle 过程会创建成千上万个短生命周期的对象。这会给 JVM 的垃圾回收器带来巨大压力,可能导致频繁的 Full GC,甚至出现 "Stop-the-World"(应用暂停),严重拖慢处理速度。

5. 打破流水线 (Breaking the Pipeline)

- Spark 的核心优势之一是 Pipeline(流水线)执行,即一条数据被读入后,可以连续经过 map、filter 等操作而不落地。

- Shuffle 是 Stage 的边界: Shuffle 操作是“宽依赖”(Wide Dependency)。这意味着子 RDD 的计算必须等待父 RDD 所有 分区都计算完成并写完磁盘后才能开始。这相当于在并行计算中设置了一个巨大的同步屏障(Barrier),无法利用流水线优势。

总结:为什么这么慢?

想象一下,你(CPU)在搬砖:

- 平时(非 Shuffle): 你从左手接砖,右手递出去,不用停,速度极快(内存流水线)。

- Shuffle 时: 你必须先把所有的砖头按照颜色分类,打包(序列化),装进箱子,写上地址,搬到卡车上(写磁盘);然后卡车开到另一个工地(网络传输);那边的工人卸货,拆箱子(反序列化),再重新按颜色堆好(排序/聚合),最后才能继续搬。

这一系列额外的打包、运输、拆包过程,就是 Spark Shuffle 开销大的原因。

如何优化?

为了减少 Shuffle 开销,通常采取以下策略:

- 减少 Shuffle 数据量: 在 Shuffle 前尽早进行

filter或map端预聚合(如使用reduceByKey代替groupByKey)。 - 避免 Shuffle: 使用 Broadcast Join(广播小表),将小表广播到所有节点,避免大表的 Shuffle。

- 参数调优: 调整

spark.sql.shuffle.partitions(控制分区数),调整内存比例,开启压缩等。

播面

播面