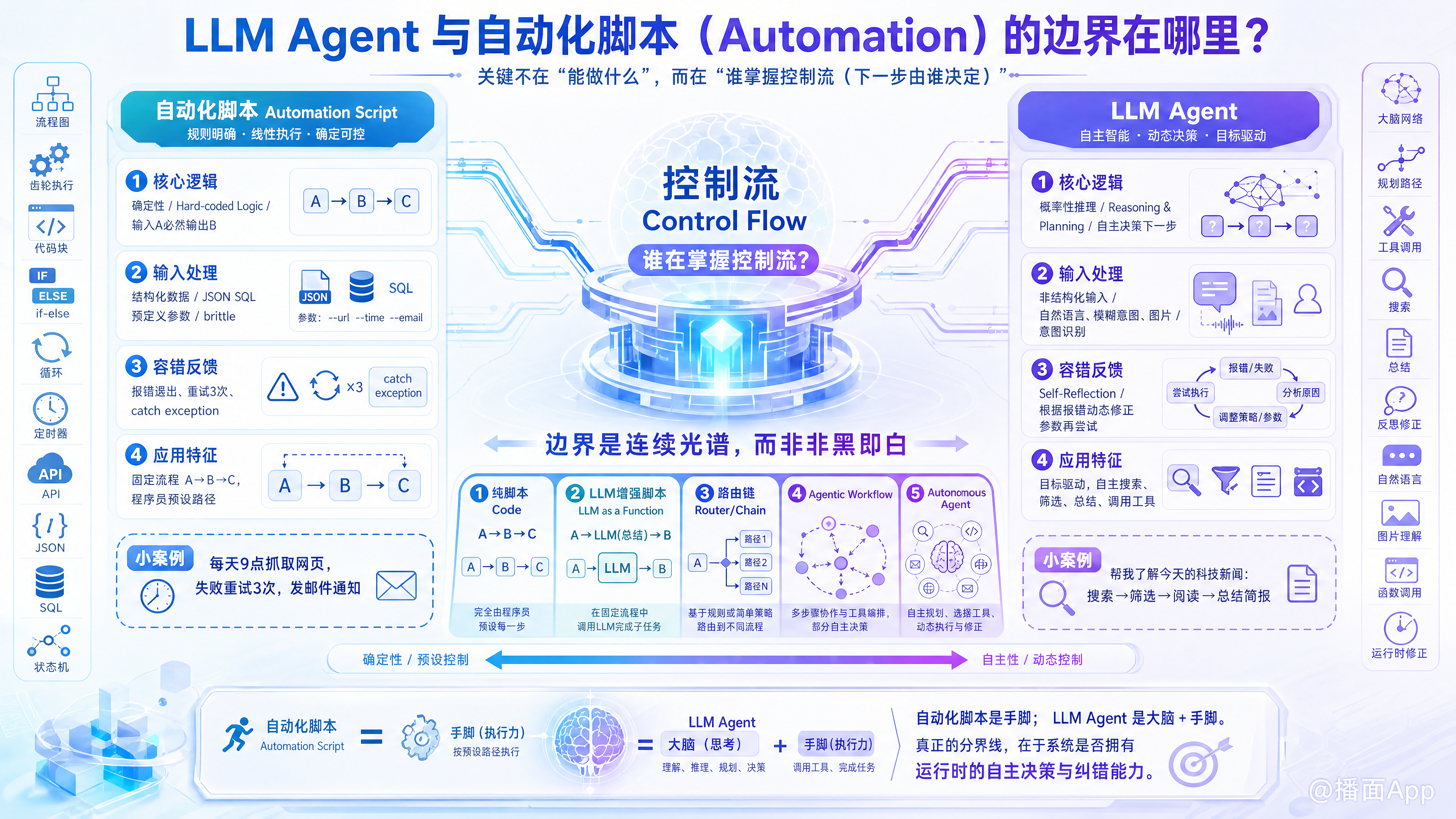

LLM Agent 与自动化脚本(Automation)的边界在哪里?

这是一个非常深刻且在当前 AI 工程化落地中经常被讨论的问题。

简单来说,自动化脚本(Automation Script)是“手脚”,而 LLM Agent 是“大脑 + 手脚”。

两者的边界并不在于它们能做什么(因为它们往往调用相同的 API),而在于谁在掌握“控制流”(Control Flow),即谁在决定“下一步做什么”。

以下从核心逻辑、适应性、容错机制和应用场景四个维度来详细拆解这个边界:

1. 核心逻辑:确定性 vs. 概率性推理

这是两者最本质的区别。

自动化脚本(Hard-coded Logic):

- 逻辑来源: 程序员预先写好的

if-else、循环和状态机。 - 特点: 确定性(Deterministic)。输入 A 必然得到输出 B。

- 边界判定: 如果流程图是静态的,无论输入什么,步骤 1 之后永远是步骤 2,这就是脚本。

- 例子: 一个 Python 脚本,每天早上 9 点抓取网页,如果抓取失败则重试 3 次,最后发邮件通知。

- 逻辑来源: 程序员预先写好的

LLM Agent(Reasoning Engine):

- 逻辑来源: LLM 根据提示词(Prompt)和上下文进行实时推理(Reasoning)和规划(Planning)。

- 特点: 概率性(Probabilistic)。LLM 可能会根据输入的不同,决定跳过步骤 2,直接进行步骤 3,或者自己发明一个新的步骤(调用工具)。

- 边界判定: 如果系统拥有自主决策权,能根据当前环境状态动态决定下一步调用哪个函数,这就是 Agent。

- 例子: 给 Agent 一个目标“帮我了解今天的科技新闻”。Agent 可能会先搜索 Google,发现内容太杂,决定去 Hacker News 看看,然后发现有一篇关于 AI 的长文,决定调用总结工具阅读它,最后写一份简报。

2. 输入处理:结构化数据 vs. 模糊意图

自动化脚本:

- 依赖结构化输入(JSON, SQL, 预定义的参数)。

- 对输入极其敏感,格式不对程序就会崩溃(Brittle)。

- 边界: 必须把需求翻译成机器能懂的参数。

LLM Agent:

- 擅长处理非结构化输入(自然语言、模糊的指令、图片)。

- 具有意图识别能力。它可以将“帮我查下这周五去上海的票”转化为

{date: "2023-10-27", dest: "Shanghai"}的结构化数据。 - 边界: 可以直接理解人类的模糊需求。

3. 容错与反馈:报错退出 vs. 自我反思

自动化脚本:

- 遇到未预定义的错误(Exception),通常会抛出异常并停止,或者进入预设的

catch块。 - 它不知道“为什么”错了,只能机械地重试或报错。

- 遇到未预定义的错误(Exception),通常会抛出异常并停止,或者进入预设的

LLM Agent:

- 具备自我反思(Self-Reflection)能力。

- 如果 Agent 调用 API 报错,它可以把错误信息喂回给 LLM,LLM 会分析:“哦,参数格式错了,我应该修正参数再试一次”。

- 边界: 具备在运行时(Runtime)动态修正错误逻辑的能力。

4. 边界的模糊地带:Agentic Workflow(代理工作流)

现在业界(如吴恩达提出的观点)倾向于认为这不仅仅是黑与白,而是一个光谱(Spectrum)。

- 纯脚本 (Code):

A -> B -> C。 - LLM 增强脚本 (LLM as a Function):

A -> LLM(总结) -> B。这里 LLM 只是一个处理文本的函数,控制流还在代码里。这依然偏向自动化。 - 路由链 (Router/Chain):

LLM(分类)->if 类别A run 脚本A/if 类别B run 脚本B。LLM 决定了分支,但分支内的动作是固定的。这是边界的中间态。 - 自主 Agent (Autonomous Agent): 给定目标,LLM 自行编写循环:

观察 -> 思考 -> 行动 -> 观察...(ReAct 模式)。这是纯 Agent。

总结:如何判断你需要哪一个?

| 维度 | 自动化脚本 (Automation) | LLM Agent |

|---|---|---|

| 任务性质 | 重复、高频、流程固定 | 探索性、低频、流程多变 |

| 可靠性要求 | 极高 (必须 100% 准确) | 中等 (允许一定的幻觉或偏差) |

| 成本/延迟 | 低成本,毫秒级响应 | 高成本 (Token),秒级响应 |

| 开发重点 | 编写代码逻辑 | 编写 Prompt 和工具定义 (Tools) |

| 比喻 | 工厂流水线 (高效、死板) | 人类实习生 (灵活、但可能犯错) |

结论:

LLM Agent 与自动化脚本的边界在于“谁定义了执行路径”。

- 如果路径是编译时(Compile time)写死的,它是自动化脚本。

- 如果路径是运行时(Runtime)由模型根据上下文生成的,它是 Agent。

目前最务实的做法是 "Agentic Workflow":用代码(脚本)框定大的流程和边界,确保稳定性;在具体的节点上,让 LLM Agent 发挥灵活处理非结构化数据和微决策的能力。

播面

播面