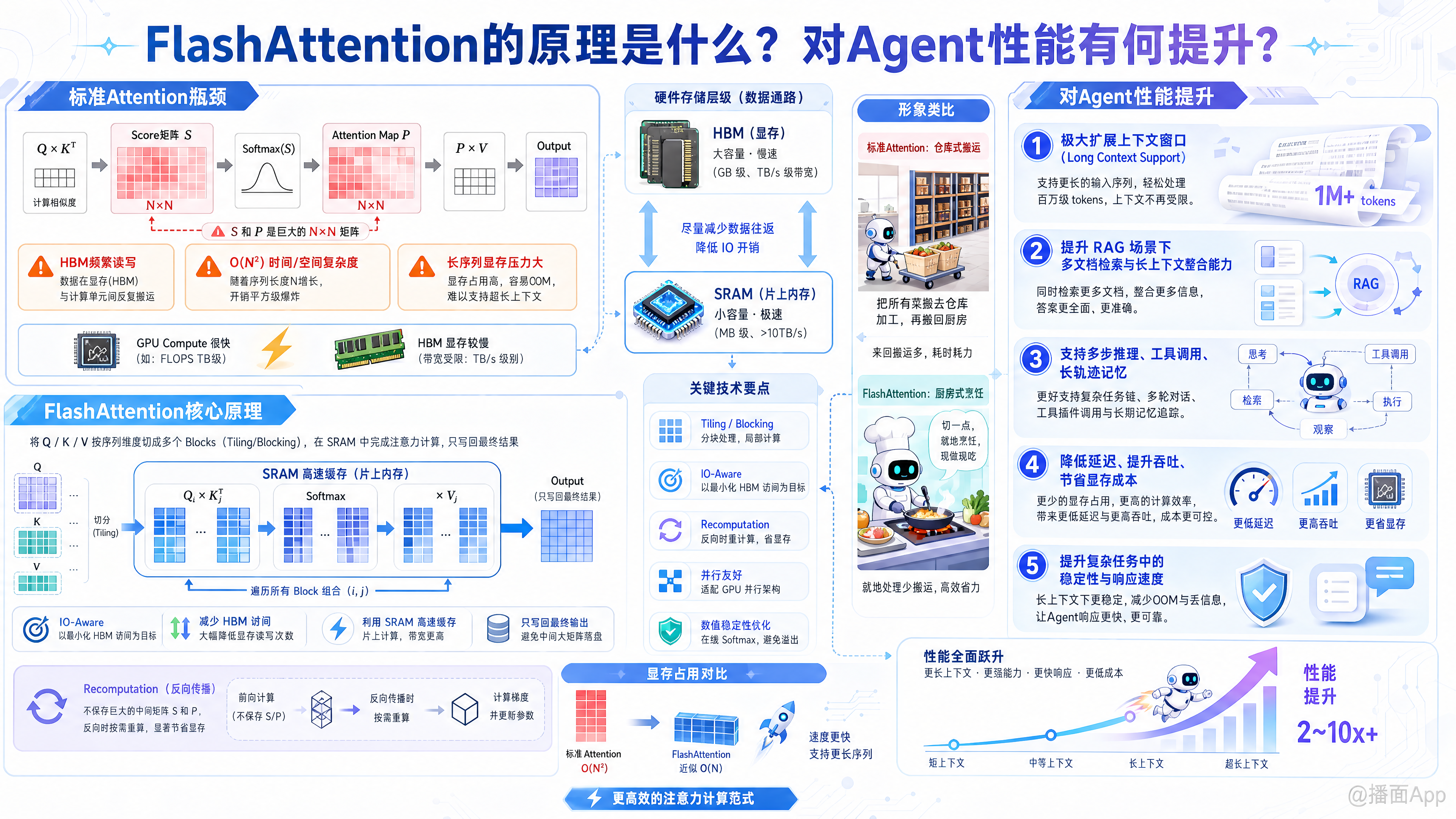

FlashAttention的原理是什么?对Agent性能有何提升?

FlashAttention 是当前大模型(LLM)领域最关键的底层优化技术之一。简单来说,它是一种通过优化 GPU 显存读写(IO)来加速 Transformer 注意力机制计算并降低显存占用的算法。

以下是对其原理及其对 AI Agent(智能体)性能提升的详细解析:

一、 FlashAttention 的核心原理

要理解 FlashAttention,首先需要理解标准 Attention 计算的瓶颈在哪里。

1. 背景:标准 Attention 的瓶颈

在标准的 Transformer 计算中,Self-Attention 的时间复杂度和空间复杂度都是 ( 是序列长度)。

- 计算过程: (Score矩阵) (Attention Map) (Output)。

- 硬件瓶颈: GPU 的计算单元(Compute)非常快,但显存(HBM, High Bandwidth Memory) 的读写速度相对较慢。

- 标准算法需要将巨大的中间矩阵( 和 ,大小为 )完整地写入 HBM,然后再读出来进行下一步计算。

- 当序列长度 变长时, 的矩阵会撑爆显存,且频繁的 HBM 读写成为了速度的“拖油瓶”。

2. FlashAttention 的解决方案:IO-Aware(IO感知)

FlashAttention 的核心思想是减少对 HBM(慢速显存)的访问次数,尽可能利用 SRAM(GPU 芯片上的快速缓存)。它主要采用了两个技术:

平铺(Tiling / Blocking):

- 它不再一次性计算整个巨大的 注意力矩阵。

- 它将 Query、Key、Value 切分成小的块(Blocks)。

- 它将这些小块加载到 SRAM(极快,但容量小)中,在 SRAM 内部完成 、Softmax 和 的计算,只将最终结果写回 HBM。

- 效果: 避免了将巨大的中间矩阵 和 写入 HBM,大幅减少了显存读写量。

重计算(Recomputation)—— 针对训练阶段:

- 在反向传播(训练)时,通常需要保存前向传播的中间矩阵来计算梯度。

- FlashAttention 选择不保存巨大的注意力矩阵,而是在反向传播时利用保存在 SRAM 中的小块信息重新计算一遍。

- 虽然增加了一点计算量(FLOPs),但由于减少了极其耗时的 HBM 读写,总速度反而更快,且显存占用从 降到了近似 。

3. 总结原理

FlashAttention 就像做菜。

- 标准 Attention: 把所有菜切好(产生巨大中间数据),全部搬到仓库(HBM),再从仓库搬回厨房(SRAM)炒菜。

- FlashAttention: 切一点菜,直接在厨房炒好(SRAM内计算),只把做好的菜端出去。省去了来回搬运的时间和仓库空间。

二、 对 Agent 性能的提升

AI Agent(智能体)通常需要处理复杂的任务,涉及长短期记忆、工具调用、多步推理等。FlashAttention 对 Agent 的性能提升是决定性的:

1. 极大扩展上下文窗口(Long Context Support)

这是对 Agent 最直接的提升。

- 原理: 由于显存占用从 降低到线性级别,模型可以处理的序列长度大幅增加。

- Agent 收益:

- RAG(检索增强生成): Agent 可以一次性阅读几十篇文档、整本书或巨大的代码库,而不是只能看几个片段。这显著提高了回答的准确性和全面性。

- 长期记忆: Agent 可以记住几万轮之前的对话细节,不再像以前那样聊几句就“失忆”。

2. 显著降低推理延迟(Latency)

- 原理: 减少了 HBM 访问瓶颈,计算速度通常比标准 Attention 快 2-4 倍(取决于序列长度,越长越明显)。

- Agent 收益:

- 用户体验: Agent 响应速度变快,用户等待时间变短。

- 复杂任务链: Agent 往往需要进行“思考-行动-观察”的循环(如 ReAct 模式)。如果每一步推理都慢,整个任务执行会极其耗时。FlashAttention 加速了每一步的推理,使复杂任务能在可接受的时间内完成。

3. 提升多步推理和规划能力

- 原理: 支持更长的上下文意味着 Agent 可以在 Prompt 中包含更多的 Few-Shot 示例(少样本学习)或者更详细的思维链(Chain-of-Thought)。

- Agent 收益:

- 通过在上下文中塞入更多的历史成功案例或详细的工具说明,Agent 的规划能力、工具调用的准确率会显著提升。

4. 降低部署成本

- 原理: 同样的显存大小现在可以跑更长的序列,或者同样的序列长度只需要更少的显卡。

- Agent 收益:

- 对于企业部署 Agent 来说,这意味着硬件成本的大幅降低,使得大规模部署高智能 Agent 成为经济上可行的方案。

总结

FlashAttention 是现代大模型能够支持 128k、200k 甚至 1M 上下文窗口的基石技术。

对于 Agent 而言,它打破了“记忆力”和“反应速度”的物理限制,使得 Agent 从“只能处理简单对话的聊天机器人”进化为“能阅读海量资料、具备长期记忆并快速执行复杂任务的智能助手”。

播面

播面