什么是 ReAct 框架?它是如何结合推理(Reasoning)和行动(Acting)的?

ReAct(Reasoning + Acting)是一个由普林斯顿大学和 Google 在 2022 年提出的框架(论文:《ReAct: Synergizing Reasoning and Acting in Language Models》)。

简单来说,ReAct 是一种让大语言模型(LLM)既能“思考”又能“做事”的提示工程(Prompt Engineering)范式。 它通过让模型交替生成推理轨迹(Reasoning Traces)和任务行动(Task-specific Actions),从而解决复杂问题。

以下是关于 ReAct 框架的详细解析,以及它是如何结合推理与行动的。

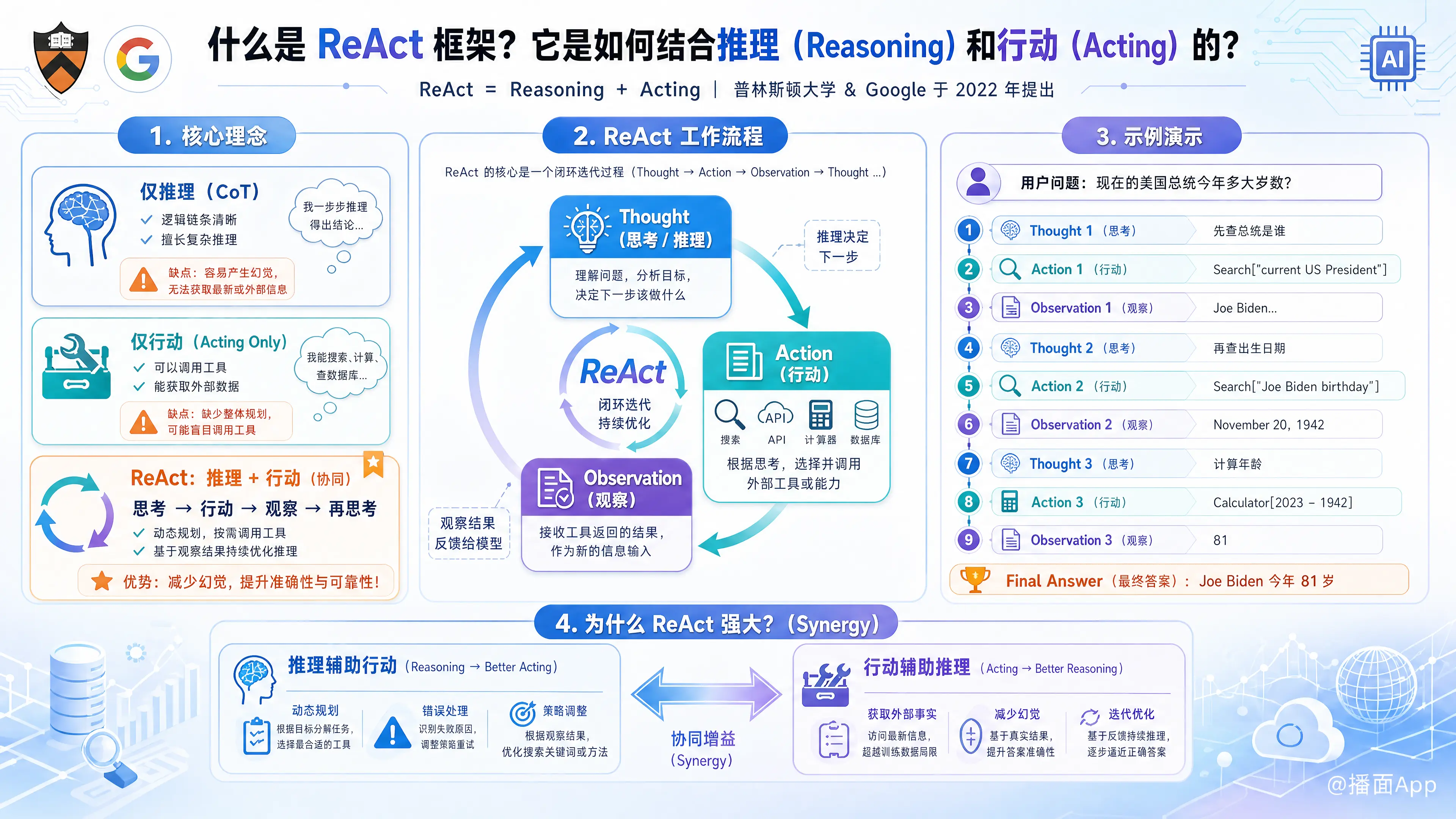

1. 核心理念:打破“只动脑”或“只动手”的局限

在 ReAct 出现之前,LLM 主要有两种使用模式,但都有缺陷:

- 仅推理(Reasoning Only): 例如思维链(Chain-of-Thought, CoT)。模型会说“让我们一步步思考”,逻辑很好,但容易产生幻觉(胡编乱造事实),因为它无法获取外部实时信息。

- 仅行动(Acting Only): 模型被训练用来调用 API(如 WebGPT)。它能获取信息,但缺乏规划能力。如果第一步搜索失败,它往往不知道该如何调整策略,容易陷入死循环。

ReAct 的结合方式:

ReAct 将两者结合,形成一个循环:思考 行动 观察 再思考。

2. ReAct 的工作流程(How it works)

ReAct 框架通过一个三元组循环来结合推理和行动:

- Thought(思考/推理): 模型用自然语言分析当前的情况,决定下一步该做什么。这相当于人类的“内心独白”。

- Action(行动): 模型生成具体的指令(例如调用搜索引擎、使用计算器、查询数据库)。

- Observation(观察): 外部工具执行 Action 后返回的结果(例如搜索到的文本片段、计算结果)。这个结果会被喂回给模型,作为下一次思考的依据。

具体的交互步骤:

- 用户提问: “现在的美国总统今年多大岁数?”

- Thought 1: 我需要先查出现在的美国总统是谁,然后再查他的出生日期,最后计算年龄。

- Action 1:

Search["current US President"] - Observation 1: (来自 Google 的结果)Joe Biden is the 46th president...

- Thought 2: 好的,总统是 Joe Biden。现在我需要查他的出生日期。

- Action 2:

Search["Joe Biden birthday"] - Observation 2: (来自 Google 的结果)November 20, 1942.

- Thought 3: 他出生于 1942 年。现在是 2023 年(假设当前时间)。我需要计算 2023 减去 1942。

- Action 3:

Calculator[2023 - 1942] - Observation 3: 81

- Thought 4: 我已经有了答案。

- Final Answer: Joe Biden 今年 81 岁。

3. 为什么这种结合如此强大?(Synergy)

ReAct 的精髓在于推理和行动是相互辅助的:

推理辅助行动(Reasoning helps Acting):

- 动态规划: 模型在行动前会制定计划。

- 错误处理: 如果 Action 的结果(Observation)显示搜索不到内容,模型会在下一个 Thought 中分析原因(“搜索词太模糊了”),并调整策略(“尝试另一个关键词”),而不是盲目重复。

- 消除歧义: 模型可以判断何时信息足够,何时需要更多信息。

行动辅助推理(Acting helps Reasoning):

- 减少幻觉: 推理不再是基于模型内部可能过时的记忆,而是基于 Observation 返回的真实、实时的外部信息(Grounding)。

- 扩展能力: 模型不需要记住所有数学公式或实时新闻,它只需要知道如何使用工具去获取这些信息。

4. 形象对比

为了理解 ReAct 的优势,我们可以对比一下三种模式处理同一个问题:“那个发明了 iPod 的公司的现任 CEO 是谁?”

- 标准 LLM(直接回答):

- 可能回答: “蒂姆·库克。”(正确,但如果问的是冷门知识,容易瞎编)

- 思维链 CoT(只推理):

- 思考: “发明 iPod 的是苹果公司。苹果公司的创始人是乔布斯,后来传给了蒂姆·库克。所以是蒂姆·库克。”(逻辑通顺,但如果库克昨天刚辞职,模型不知道,因为它无法联网更新信息)。

- ReAct(推理 + 行动):

- Thought: 我需要先确认谁发明了 iPod。

- Action: 搜索“iPod inventor company”。

- Observation: 结果显示是 Apple Inc.。

- Thought: 好的,是 Apple。现在我需要查 Apple 的现任 CEO。

- Action: 搜索“Apple Inc current CEO”。

- Observation: 结果显示 Tim Cook。

- Thought: 确认是 Tim Cook。

- Answer: 蒂姆·库克。

5. 总结

ReAct 框架是现代 AI Agent(智能体)构建的基石。像 LangChain 这样的开发库,其核心的 Agent 实现机制大多就是基于 ReAct 模式。

它通过“显式的推理轨迹”(让模型把想法写出来)和“工具使用能力”(让模型与世界交互)的紧密交织,使大模型从一个单纯的“聊天机器人”进化为了一个能够解决复杂问题、具备自主纠错能力的“智能助手”。

播面

播面