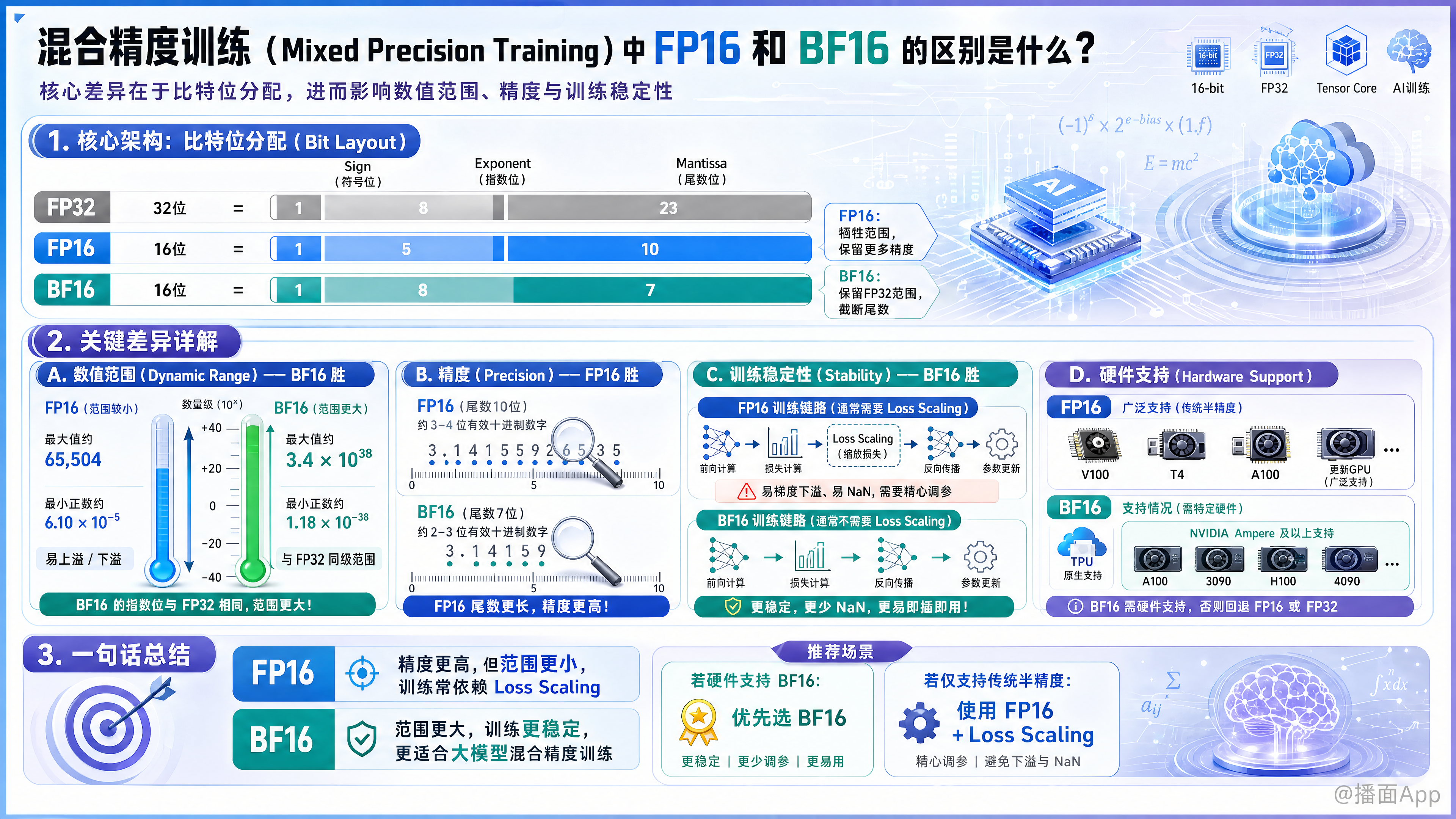

混合精度训练(Mixed Precision Training)中FP16 和 BF16 的区别是什么?

在混合精度训练(Mixed Precision Training)中,FP16 (Half Precision) 和 BF16 (Brain Floating Point) 是两种最常用的低精度浮点数格式。

它们的核心区别在于比特位的分配方式,这直接导致了它们在数值范围(Range)、精度(Precision)以及训练稳定性上的显著差异。

以下是详细的对比解析:

1. 核心架构:比特位分配 (Bit Layout)

这两种格式都使用 16 个比特(bits)来表示一个数字,但内部结构不同。作为参考,标准的 FP32 (单精度) 是:1位符号 + 8位指数 + 23位尾数。

| 格式 | 总位数 | 符号位 (Sign) | 指数位 (Exponent) | 尾数位 (Mantissa/Fraction) |

|---|---|---|---|---|

| FP32 | 32 | 1 | 8 | 23 |

| FP16 | 16 | 1 | 5 | 10 |

| BF16 | 16 | 1 | 8 | 7 |

- FP16:为了保留较高的精度,牺牲了指数位(范围),保留了较多的尾数位。

- BF16:为了保持与 FP32 相同的动态范围,直接截断了 FP32 的尾数,保留了与 FP32 相同的 8 位指数。

2. 关键差异详解

A. 数值范围 (Dynamic Range) —— BF16 胜

- FP16:指数位只有 5 位,能表示的最大数值约为 。

- 问题:在深度学习训练中,梯度或激活值很容易超过这个范围(上溢 Overflow)或者变得极小(下溢 Underflow)。

- BF16:指数位有 8 位,与 FP32 一样,能表示的最大数值约为 。

- 优势:极难发生上溢或下溢,数值范围非常宽广。

B. 精度 (Precision) —— FP16 胜

- FP16:尾数有 10 位,大约有 3-4 位有效十进制数字。

- BF16:尾数只有 7 位,大约有 2-3 位有效十进制数字。

- 实际影响:虽然 BF16 精度较低,但深度学习模型(尤其是大模型)通常对噪声有很强的鲁棒性,因此这种精度的损失通常不会影响模型的最终收敛效果。

C. 训练稳定性 (Stability) —— BF16 胜

这是 BF16 越来越受欢迎的主要原因:

- FP16:由于范围窄,容易发生梯度下溢(变成0)。因此,必须使用 Loss Scaling(损失缩放) 技术,将 Loss 放大以保住梯度,更新权重后再缩小回去。这增加了训练的复杂性。

- BF16:由于范围宽,通常不需要 Loss Scaling。它可以像 FP32 一样直接“即插即用”,大大简化了混合精度训练的流程,且训练过程更稳定(不容易出现 NaN)。

D. 硬件支持 (Hardware Support)

- FP16:支持范围最广。NVIDIA 的 Volta (V100)、Turing (T4)、Ampere (A100) 以及更新的显卡都支持。

- BF16:主要是针对较新的硬件。

- Google TPU:原生支持(BF16 就是 Google Brain 发明的)。

- NVIDIA GPU:需要 Ampere 架构 (A100, 3090) 或更新的 Hopper (H100, 4090) 才支持。V100 和 T4 不支持 BF16 加速。

3. 总结对比表

| 特性 | FP16 (IEEE 754 Half) | BF16 (Brain Floating Point) |

|---|---|---|

| 设计理念 | 平衡精度与范围 | 牺牲精度,换取与 FP32 相同的范围 |

| 数值范围 | 窄 () | 宽 (,同 FP32) |

| 计算精度 | 较高 | 较低 |

| Loss Scaling | 必须 (防止下溢) | 通常不需要 |

| 转换便利性 | 较麻烦 (需处理溢出) | 极简 (直接截断 FP32 尾数) |

| 硬件要求 | V100, T4, A100, H100 等 | A100, H100, TPU (旧卡不支持) |

| 主要用途 | 传统混合精度,推理加速 | 大模型训练 (LLM),新硬件首选 |

4. 结论:该选哪个?

- 如果你有 A100/H100/TPU 等新硬件:首选 BF16。它更稳定,不需要折腾 Loss Scaler,是大语言模型(LLM)训练的标准配置。

- 如果你使用 V100/2080Ti/T4 等旧硬件:你只能使用 FP16。虽然需要处理 Loss Scaling,但它依然能提供比 FP32 快得多的速度。

- 在推理(Inference)阶段:FP16 有时比 BF16 更受欢迎,因为推理通常不需要反向传播(不需要处理梯度下溢),而 FP16 较高的精度有助于保持模型输出的质量。

播面

播面