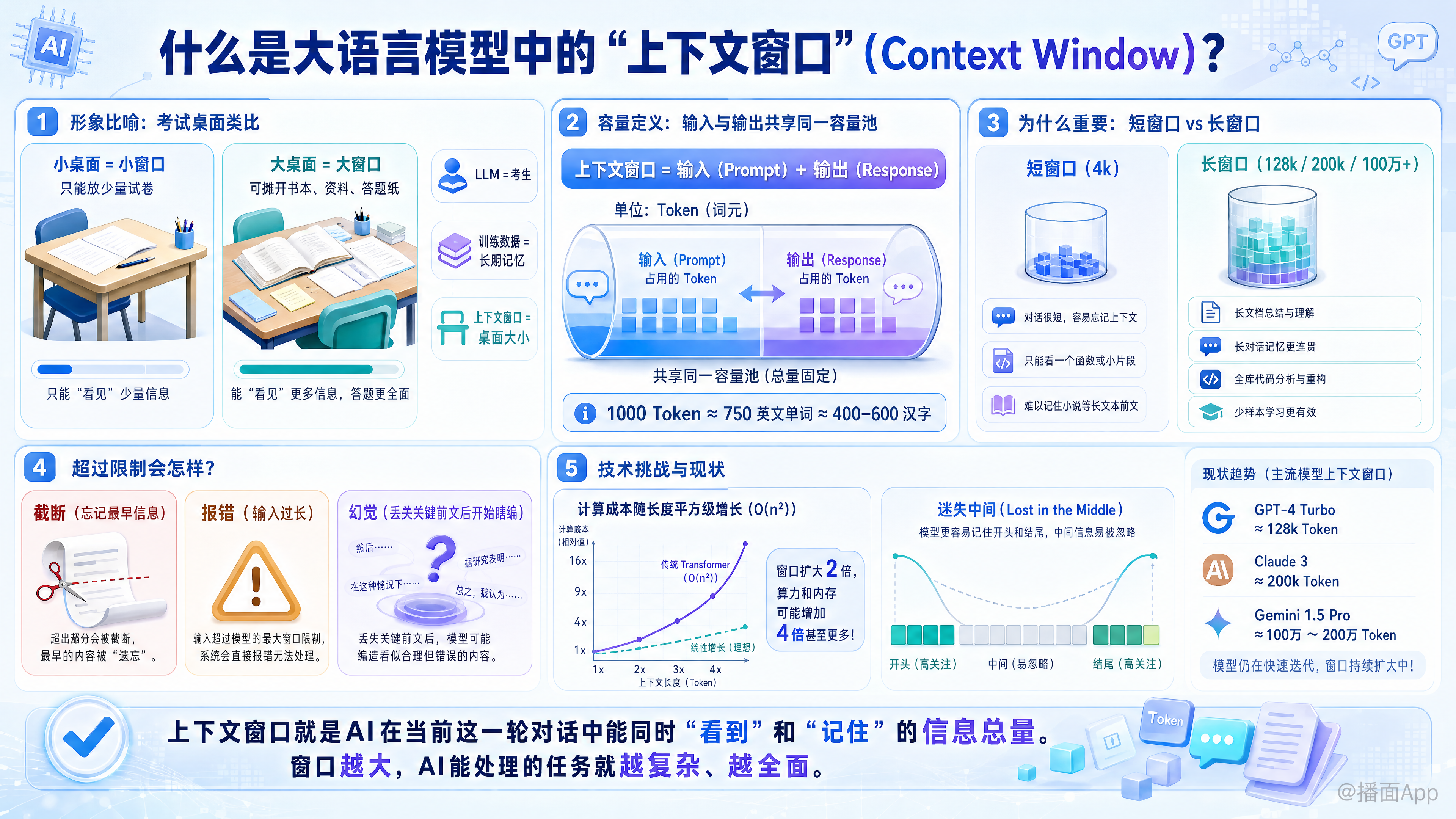

什么是大语言模型中的“上下文窗口”(Context Window)?

在大语言模型(LLM)中,“上下文窗口”(Context Window) 是一个非常核心的概念。

简单来说,你可以把它理解为模型的“短期记忆”容量,或者是它的“一次性阅读量”上限。

为了让你更直观地理解,我们可以从以下几个维度来拆解:

1. 形象的比喻

想象你在参加一场考试:

- 大语言模型(LLM) 是考生。

- 训练数据(Training Data) 是考生在过去几年里学到的所有知识(长期记忆)。

- 上下文窗口(Context Window) 是考生的桌面大小。

如果桌面很小(窗口小),你只能在桌上放一张试卷,做完这页必须把之前的扔掉才能放新的。你无法参考前面的题目,也记不住刚才写了什么。

如果桌面很大(窗口大),你可以同时摊开整本教科书、几十页的参考资料和你的答题纸。你可以随时查阅前面的内容,结合大量信息来回答问题。

2. 具体包含什么?

上下文窗口的容量计算单位通常是 Token(词元),而不是单词或字符(1000个Token大约等于750个英文单词,或400-600个汉字)。

上下文窗口 = 输入(Prompt) + 输出(Response)

这意味着,这个窗口不仅要装下你发给它的内容(比如你上传的一篇长文章),还要预留空间给它生成的回答。如果你的输入太长,占满了窗口,模型就没法生成完整的回答,或者会被迫“忘记”你输入的前半部分内容。

3. 为什么上下文窗口很重要?

上下文窗口的大小直接决定了模型能处理任务的复杂度:

短窗口(如早期的 4k tokens):

- 只能进行简短的对话。

- 如果你发给它一本长篇小说让它总结,它读到第10章时,就已经完全忘记第1章的主角是谁了。

- 在写代码时,它只能看到当前的一个函数,无法理解整个项目的架构。

长窗口(如现在的 128k、200k 甚至 100万+ tokens):

- 处理长文档: 你可以直接把几百页的财报、法律合同或整本书丢给它,让它提炼重点。

- 超长对话: 它可以记住你们几天前聊过的细节,保持对话的连贯性。

- 全库代码分析: 它可以一次性读取整个软件项目的代码库,帮你修复跨文件的Bug。

- 少样本学习(In-context Learning): 你可以在提示词里给它几十个范例,它能通过这些范例迅速学会新任务,而不需要重新训练模型。

4. 超过窗口限制会发生什么?

当对话或输入的内容超过了模型的上下文窗口限制,通常会发生以下情况:

- 截断(Truncation): 模型会强制切掉最早的信息。这就好比金鱼的记忆,聊着聊着,它就忘了最开始你们设定的规则。

- 报错: 系统直接提示“输入过长”,拒绝处理。

- 胡言乱语(幻觉): 因为丢失了关键的前文信息,模型可能会开始瞎编乱造。

5. 技术挑战与现状

虽然我们都希望窗口无限大,但增加窗口大小有巨大的技术成本:

- 计算成本: 传统Transformer架构的计算量是随长度呈平方级增长的。窗口扩大2倍,计算量和内存消耗可能会增加4倍甚至更多。

- 迷失中间(Lost in the Middle): 研究发现,即使窗口很大,模型往往只对开头和结尾的信息印象深刻,而容易忽略中间部分的信息。

目前的趋势:

- GPT-4 Turbo: 约 128k tokens(约等于300页书)。

- Claude 3: 200k tokens。

- Gemini 1.5 Pro: 支持 100万甚至 200万 tokens(可以处理数小时的视频或极长的代码库)。

总结:

上下文窗口就是AI在当前这一轮对话中能同时“看到”和“记住”的信息总量。窗口越大,AI能处理的任务就越复杂、越全面。

播面

播面