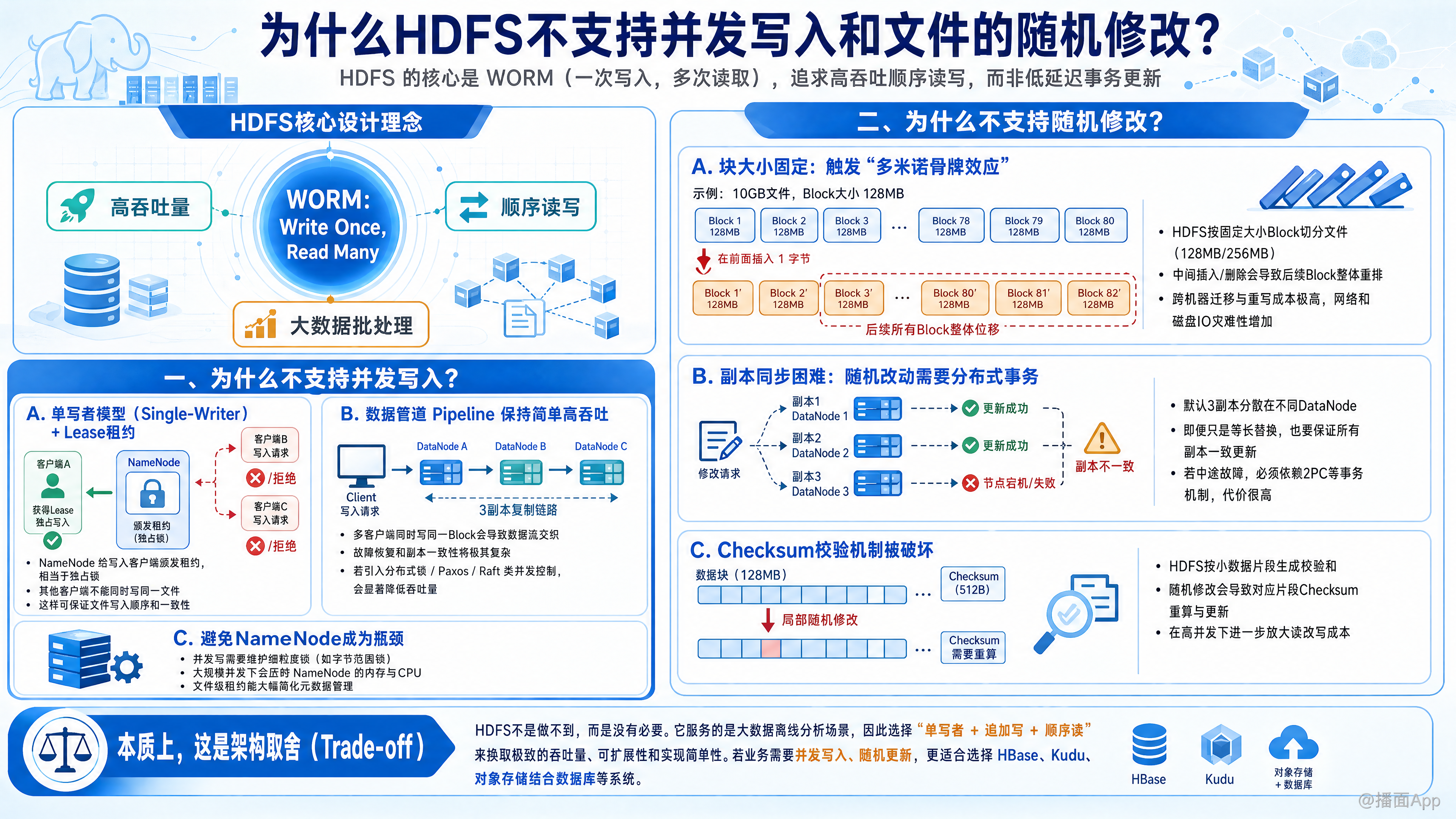

为什么HDFS不支持并发写入和文件的随机修改?

HDFS(Hadoop Distributed File System)不支持多个客户端并发写入同一个文件,也不支持对文件进行随机修改(Random Write/Update)。这种设计并非技术上无法实现,而是基于 HDFS 的核心设计目标和应用场景(大数据批处理)做出的刻意的架构取舍(Trade-off)。

HDFS 的核心设计理念是 WORM(Write Once, Read Many,一次写入,多次读取),追求的是高吞吐量的连续顺序读写,而非低延迟的事务处理。

以下是具体的深度原因分析:

一、 为什么不支持并发写入(Concurrent Writes)?

HDFS 采用的是单写者模型(Single-Writer Model)。当一个客户端打开一个文件进行写入时,NameNode 会给该客户端颁发一个租约(Lease),也就是一把独占锁。其他客户端试图写入同一个文件时会被拒绝。原因如下:

1. 保证数据一致性与写入管道(Pipeline)的简单性

HDFS 的数据写入是通过数据管道(Data Pipeline)完成的。客户端从 NameNode 获取一个 Block 的存放节点列表(如 A, B, C),然后客户端将数据顺序发给 A,A 发给 B,B 发给 C。

- 如果允许多个客户端同时往同一个 Block 写数据,多个数据流在 DataNode 上如何交织?

- 如果发生节点故障,如何恢复并保证三个副本的数据完全一致?

- 为了解决这些问题,必须引入极其复杂的分布式锁和并发控制机制(如 Paxos/Raft 协议的变种),这将彻底破坏 HDFS "简单且高吞吐" 的写入性能。

2. 避免 NameNode 成为性能瓶颈

NameNode 是 HDFS 的单点(尽管有 HA,但同一时间只有一个 Active 负责写请求)。如果支持并发写入,NameNode 就需要维护文件内部极细粒度的锁状态(例如字节范围锁)。在大数据集群中,成千上万的并发请求会瞬间把 NameNode 的内存和 CPU 压垮。单写者模型+租约机制使得 NameNode 只需要维护文件级别的简单锁,极大地减轻了 NameNode 的负担。

二、 为什么不支持随机修改(Random Modifications)?

HDFS 仅仅支持在文件末尾追加(Append)数据(从 Hadoop 2.0 开始支持),但绝对不支持在文件的任意位置进行修改、插入或删除。原因如下:

1. 块大小固定的 "多米诺骨牌效应"(Block Shifting)

HDFS 将文件切割成固定大小的块(默认 128MB 或 256MB)。

- 插入/删除问题:如果你在一个 10GB 文件的第 10MB 处插入了 1 个字节,那么当前 Block 的大小就会变成 128MB + 1 Byte,超出了固定块大小。为了维持块大小,超出的这 1 个字节必须移到下一个 Block,下一个 Block 的最后 1 个字节又要移到下下个 Block……这会导致整个 10GB 文件的所有后续数据块全部需要重新计算和跨网络迁移。这种网络和磁盘 IO 开销在分布式系统中是灾难性的。

2. 分布式副本同步极其困难(就地修改问题)

哪怕你只是等长替换(比如将文件中间的 "A" 替换成 "B",不改变文件大小),也会带来巨大的问题。

HDFS 的每个 Block 默认有 3 个副本分散在不同的机器上。如果你随机修改某个位置的数据:

- 如何保证 3 个副本同时修改成功?

- 如果修改到一半,某台 DataNode 宕机了,副本之间的数据就会不一致。要解决这个问题,就必须引入分布式事务(如两阶段提交 2PC)。而分布式事务极其昂贵,这与 HDFS 追求的大规模数据吞吐量背道而驰。

3. 破坏了 Checksum(校验和)机制

HDFS 为了保证数据完整性,在写入时会对每 512 字节的数据生成一个 Checksum。如果支持随机修改某几个字节,就必须重新读取这 512 字节,重新计算 Checksum 并更新。在高并发下,这种 Read-Modify-Write 的操作会产生极大的磁盘随机寻道开销,导致磁盘 IO 性能暴跌。

三、 总结与替代方案

总结:

HDFS 放弃了并发写和随机修改,换来的是:

- 极简的元数据管理(NameNode 压力小,集群规模可以做得很大)。

- 极高的顺序读写吞吐量(非常适合 MapReduce/Spark 等批处理框架线性处理海量数据)。

- 极强的数据一致性和容错能力(因为文件不可变,副本同步变得异常简单)。

如果业务确实需要随机读写和并发修改,该怎么办?

在 Hadoop 生态中,通常使用其他组件来弥补 HDFS 的这一限制:

- HBase / Cassandra:构建在 HDFS 之上的 NoSQL 数据库。它们在内存中接收随机写入,并以顺序追加(WAL + SSTable 机制)的方式持久化到 HDFS,从而巧妙地在 HDFS 之上实现了低延迟的随机增删改查。

- 数据湖格式(Apache Iceberg / Hudi / Delta Lake):在 HDFS/对象存储之上,通过多版本并发控制(MVCC)和写时复制/读时合并(Copy-On-Write / Merge-On-Read)的技术,在逻辑层面上实现了对大数据的并发更新和行级修改。

播面

播面