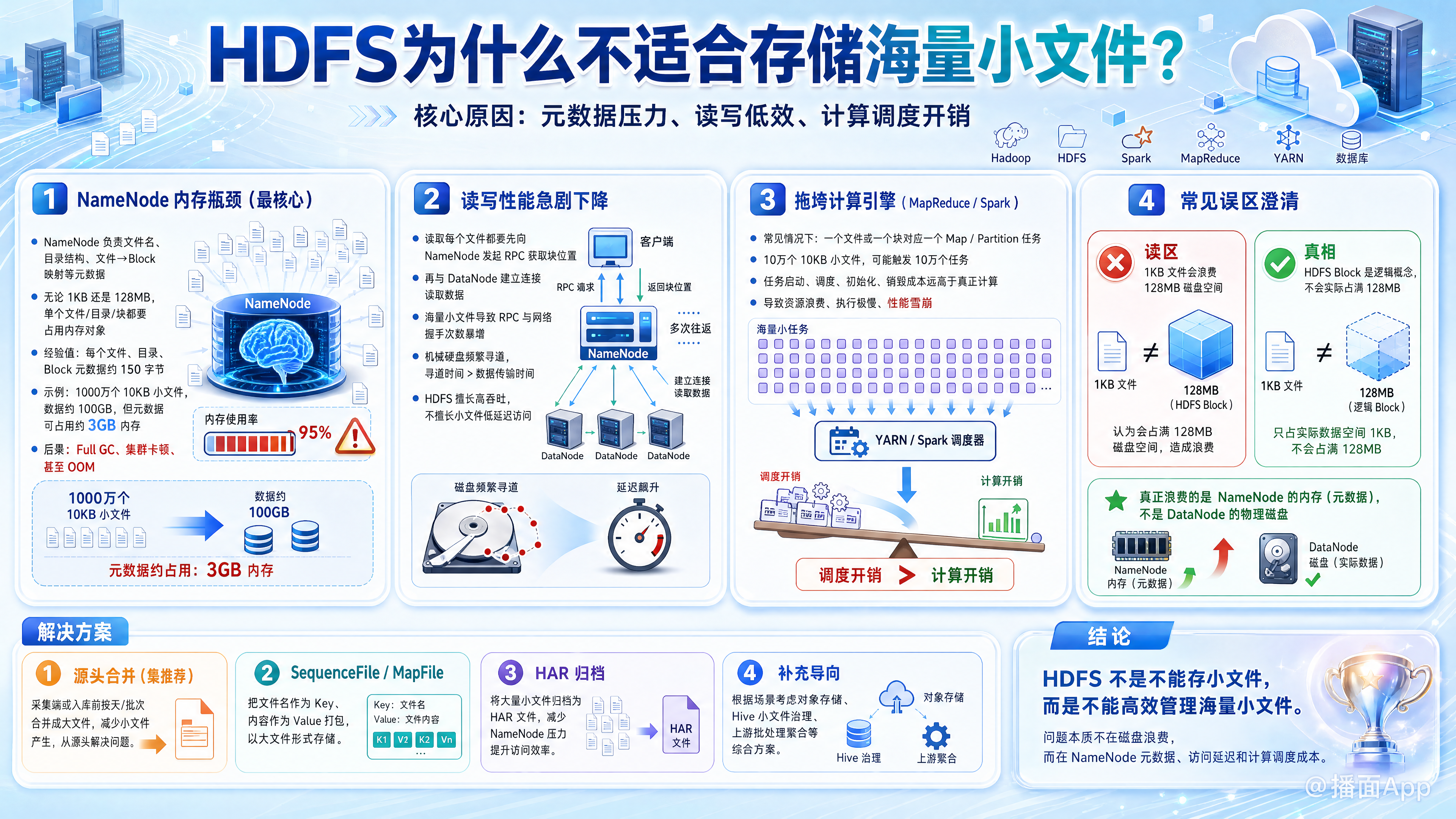

HDFS为什么不适合存储海量小文件?

HDFS(Hadoop Distributed File System)被设计为用来处理超大文件(通常是GB、TB、PB级别)和流式数据访问模式的。它非常不适合存储海量小文件(小文件通常指大小远小于HDFS默认块大小,如小于128MB的文件)。

导致这一限制的原因主要集中在元数据管理、读写性能以及计算框架的开销三个方面。以下是详细的深度剖析:

1. NameNode 的内存瓶颈(最核心原因)

HDFS的架构是 Master/Slave 结构,其中 NameNode(主节点)负责管理文件系统的命名空间(即元数据:文件名、目录结构、文件到块的映射关系等)。

- 内存占用固定: 在 NameNode 中,每一个文件、目录和数据块(Block)都会作为一个对象存储在内存中。无论这个文件是 1KB 还是 128MB,它在 NameNode 中占用的元数据大小几乎是一样的(大约 150字节)。

- 算一笔账: 如果你有 1000 万个 10KB 的小文件,实际数据量只有约 100GB。但为了管理这些文件,NameNode 需要在内存中维护 1000 万个文件对象和 1000 万个块对象,占用约 3GB 的宝贵内存。

- 后果: 随着小文件数量达到亿级别,NameNode 的内存会被迅速耗尽,导致频繁触发 JVM 的 Full GC(垃圾回收),造成整个 HDFS 集群卡顿甚至 NameNode 崩溃(OOM)。

2. 读写性能极速下降(寻道时间 > 传输时间)

HDFS 的设计初衷是为了追求高吞吐量(连续读取大文件),而不是低延迟。

- 读取开销: 读取每一个文件时,客户端都需要先和 NameNode 进行一次 RPC 通信获取文件块的位置,然后再去和 DataNode 建立网络连接读取数据。如果是海量小文件,RPC 请求和网络握手的次数将呈指数级增加,导致极高的网络延迟。

- 磁盘寻道开销: 在普通机械硬盘上,读取大量小文件意味着磁头需要频繁地在磁盘上进行寻道(Seek)。寻道时间(毫秒级)将远超实际的数据传输时间,导致磁盘 I/O 效率极其低下。

3. 严重拖垮计算引擎(如 MapReduce / Spark)

HDFS 通常与大数据计算框架结合使用。海量小文件会对计算层造成灾难性的影响:

- 任务调度开销: 默认情况下,MapReduce 或 Spark 处理 HDFS 数据时,一个文件(或一个块)对应一个 Map/Partition 任务。

- 性能雪崩: 如果有 10 万个 10KB 的小文件,YARN/Spark 会启动 10 万个 Map 任务。每个任务的启动、环境初始化和销毁的时间可能需要几秒钟,而真正处理 10KB 数据只需几毫秒。资源调度和任务管理的开销远远超过了实际的计算开销,导致集群计算资源被严重浪费,任务执行极慢。

💡 一个常见的误区澄清

误区: “HDFS 默认块大小是 128MB,如果存一个 1KB 的文件,会浪费 128MB 的磁盘空间。”

真相: 并不是这样。HDFS 中的块(Block)是一个逻辑概念。一个 1KB 的文件在 DataNode 硬盘上实际上只占用 1KB(加上少许校验和数据)的物理空间,不会浪费物理存储容量。它浪费的仅仅是 NameNode 的内存容量(元数据)。

面对海量小文件,应该如何解决?

如果在实际业务中必须处理海量小文件,通常有以下几种解决方案:

- 源头合并(最推荐): 在数据采集端(如 Flume、DataX)或上传 HDFS 之前,先将小文件合并成大文件(如按天切分成 1GB 的文件)再写入 HDFS。

- 使用 SequenceFile / MapFile: 这是 Hadoop 提供的一种二进制文件格式。可以将文件名作为 Key,文件内容作为 Value,将百万个小文件打包成一个大文件存储。

- Hadoop Archive (HAR): Hadoop 提供的归档工具,可以将大量小文件打包成一个 HAR 文件。它既减少了 NameNode 的内存消耗,又允许你透明地访问里面的小文件。

- 更换存储引擎: 如果业务场景就是海量小文件的随机读写,应该放弃 HDFS,改用 HBase、Ceph 或者 OSS/S3 等对象存储,它们在底层架构上天然适合处理海量小文件。

- 计算侧优化: 在 Spark 中使用

repartition()或coalesce()减少分区;在 MapReduce 中使用CombineTextInputFormat将多个小文件合并到一个 Map Task 中处理。

播面

播面